分布式训练基础:DP、TP、PP 与 Rank

一、什么是策略文件

二、Lora的原理以及参数的含义

- LoRA原理

- lora_rank与lora_alpha

三、分布式训练基础知识

主要分为:

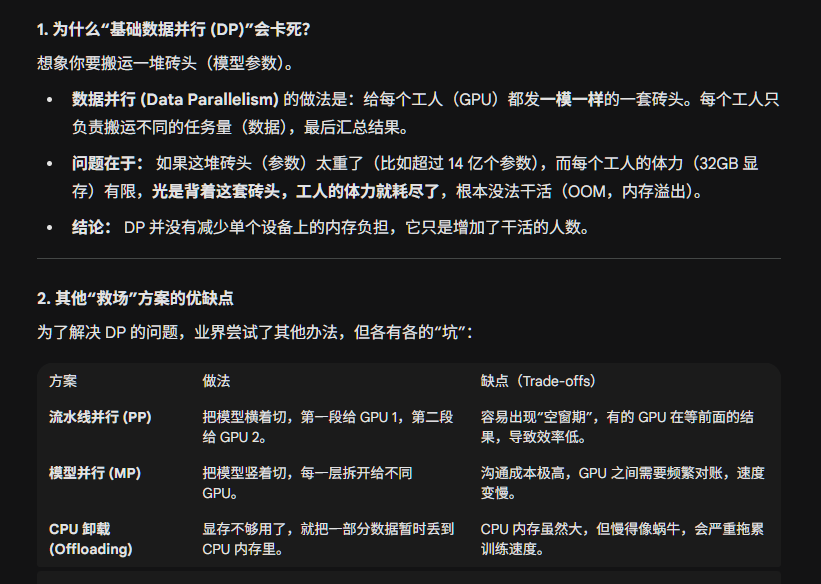

- 数据并行

- 模型并行

- 流水并行

- 混合并行 常见的分布式并行策略 - OneFlow

MP狭义上指的是TP,广义上包含TP和PP

- TP模型权重划分

- PP:模型层的划分,比如0-9层给GPU0,10-19层给GPU1

关于显卡、显存、机器? 计算资源常识 多卡估计

关于超参数? Micro Batch Size

- Node(节点):

- 定义:在分布式计算中,

node通常指的是计算集群中的一个物理或虚拟的机器。每个节点上可能有多个 CPU、内存、磁盘等资源,也可能有多个处理核心(core)来处理任务。可以把节点看作是分布式系统中一个独立的计算单位。 - 作用:每个节点可以运行一个或多个并行进程,每个节点负责处理系统中一部分的计算任务,节点之间通过网络进行通信。

- 定义:在分布式计算中,

- Rank(排名):

- 定义:在并行计算中,

rank指的是一个进程在一个节点或整个计算系统中的唯一标识符。每个进程都会被分配一个唯一的rank,通常是一个从0开始的整数。 - 作用:

rank用于标识进程,并使其能够识别自己在整个计算中的位置。在 MPI 中,每个进程会根据rank知道如何与其他进程进行数据通信。比如,rank 0通常作为主进程,用于协调任务,而其他rank对应的进程则执行具体计算。

- 定义:在并行计算中,

- 在单机多卡环境下,通常将其算作 一个 node,但这个 node 上有多个计算卡(GPU),每个卡上可以运行不同的进程(每个进程可能对应一个

rank)。